상명대학교 / 서광규 교수

3. AIaaS 플랫폼: 기획에서 배포까지

개념적 AIaaS 아키텍처는 실제 구축에 적용되어 클라우드, 포그, 엣지 네트워크에서 AI 서비스를 제공할 수 있다. 본 장에서는 AIaaS 플랫폼의 서비스를 통합하여 상용 애플리케이션의 기능과 최종 사용자 경험을 개선할 수 있는 몇 가지 잠재적 사용 사례를 기술한다.

3-1. 클라우드 구축

많은 애플리케이션이 구축 용이성과 낮은 유지 관리 비용 덕분에 클라우드에 구축되고 있다. 고객 대면 애플리케이션을 운영하는 기업은 고객 서비스 속도 향상, 정확한 응답, 전반적인 고객 만족도 향상을 위해 AI 서비스를 점점 더 많이 도입하고 있다. 클라우드 인프라에서 운영 가능한 AI 기반 비즈니스 서비스에는 챗봇, AI 기반 헬프데스크, 생성/대화형 AI 및 텍스트 분석 도구, 얼굴 인식 서비스, 사기 탐지 및 예방 등이 있다. 고객 상호 작용을 위한 AIaaS의 이점으로는 지속적인 AI 도구, 일관된 거래 결과, 실시간 응답, 개인화된 고객 경험, 매출 증대 등이 있다. AI 지원 클라우드 서비스의 요구 사항을 이해하기 위해 생성형 챗봇 시나리오의 AI 작업에 대해서 기술한다. 또한 AIaaS 서비스에서 이를 프로비저닝하는 방법과 온프레미스 구축 방식과 클라우드 기반 AIaaS 플랫폼 구축 방식의 장단점에 대해서도 살펴보기로 한다.

3-1-1. 생성형 챗봇

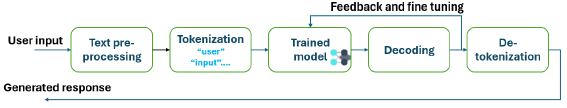

챗봇은 사람과 기계 간의 대화를 자동화하는 프로그램이다. 응답 생성 방식에 따라 규칙 기반 또는 데이터 기반으로 분류할 수 있다. 데이터 기반 챗봇은 통계 또는 머신러닝 모델을 사용하여 사람과 유사한 응답을 생성한다. 챗봇은 사람의 응답, 감정, 그리고 비즈니스에 특화된 고객 문의를 이해하도록 훈련될 수 있다. 이를 위해서는 자연어 처리(NLP), 자연어 이해, 그리고 자연어 생성 서비스가 필요하다. 이로 인해 미리 작성된 응답 목록에서 선택하는 대신, 처음부터 응답을 생성하는 더 복잡한 작업을 수행하는 생성형 챗봇이 개발되었다. NLP/NLU 작업에는 토큰화, 품사 태깅, 개체명 인식, 의미 및 감정 분석이 포함된다. 이를 통해 사용자의 의도와 의미를 파악할 수 있다. NLP/NLU 파이프라인의 많은 작업은 사용자 입력을 분석하고 쿼리를 정확하게 이해하는 것을 목표로 하는 ML/DL 기반 작업이다. 예를 들어, 품사 태깅은 레이블이 Part-Of-Speech (POS)가 있는 문장을 기반으로 훈련된 확률론적 모델을 활용할 수 있다. 마찬가지로, 개체명 인식은 사람, 조직, 날짜, 위치 및 문장의 중요 요소를 식별하는 데 중점을 둔다. 또한, 잠재 의미 및 감정 분석은 사용자 입력의 의미와 기분(긍정적, 부정적, 중립적)을 파악하여 챗봇이 생성하는 응답에 맥락과 공감을 더하는 것을 목표로 하는 ML/DL 작업이다. 챗봇의 다른 AI 작업으로는 정보 추출(IE), 대화 관리, 응답 생성, 피드백 학습 및 모델 개선이 있다. 예를 들어, IE는 은닉 벡터 상태 모델, 지원 벡터 머신 모델, 조건부 난수 필드 모델 또는 딥러닝 모델과 같은 통계 모델을 사용하여 발화(U)에서 의미(M)를 도출하고 조건부 확률을 최대화한다. 응답 생성 모듈은 seq2seq 및 변환기 기반과 같은 생성 모델을 사용하여 사용자 질의에 더욱 인간적인 방식으로 응답할 수 있다. 그림 6은 사용자 질의에 응답하는 생성 챗봇의 다양한 단계를 보여준다. 최신 챗봇은 사용자 지정 데이터 소스에서 학습된 LLM을 사용하여 인간적인 응답을 생성할 수 있다. 생성 챗봇 서비스는 다양한 AI 작업에 크게 의존하므로 사용자 요청 처리에 필요한 AI 워크플로의 여러 측면을 처리할 수 있는 AIaaS 서비스 플랫폼에 배포하는 데 적합하다. 이러한 모든 작업은 ML/DL 알고리즘에 의존하는 생성 챗봇의 필수 구성 요소를 신속하게 배포할 수 있는 AIaaS 서비스 플랫폼을 사용하여 수행할 수 있다.

[그림6. 사용자 질의에 대한 생성형 챗봇 응답 생성 단계]

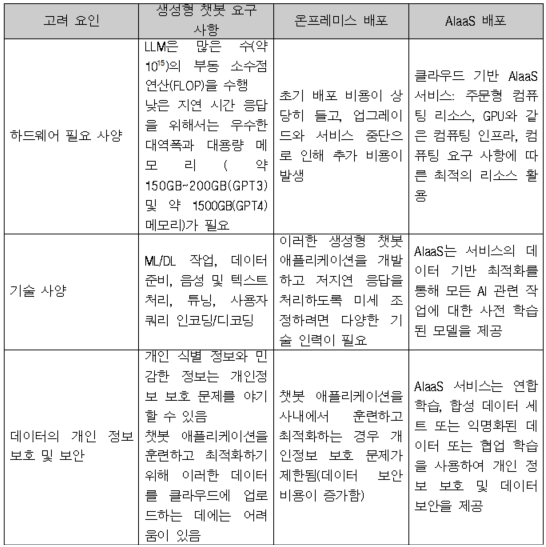

표 3은 온프레미스 환경에서 챗봇을 개발 및 호스팅하는 방식과 AIaaS 플랫폼에서 호스팅하는 방식을 비교한 것이다.

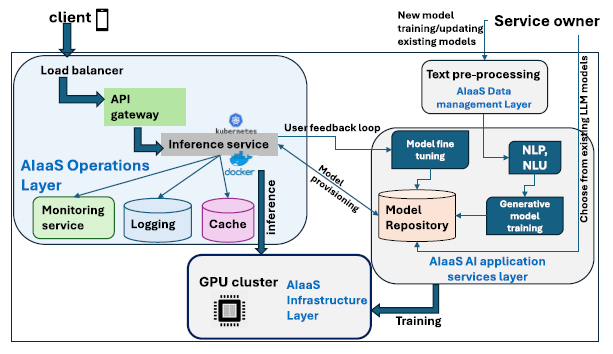

그림 7은 생성형 챗봇의 AI 작업이 AIaaS 서비스의 기능을 어떻게 활용할 수 있는지 보여준다.

[표3. 온프레미스 구축과 AIaaS 비교]

[그림7. 생성형 챗봇 애플리케이션에 대한 AIaaS 사용 사례]

이 배포 시나리오에서 추론 서비스는 애플리케이션 프런트엔드가 추론 엔진에 API 호출을 보내는 API 게이트웨이를 통해 고객에게 제공될 수 있다. 추론 엔진은 Docker와 같은 도구를 사용하여 컨테이너에 배포하고 Kubernetes와 같은 도구를 사용하여 확장할 수 있다. 서비스 수요에 따라 플랫폼을 자동으로 할당하고 확장하여 GPU 클러스터의 리소스를 사용하여 추론 및 응답 시간을 허용 가능한 한도 내로 유지할 수 있다. 예를 들어, Kubernetes는 HPA(Horizontal Pod Autoscaler)와 VPA(Vertical Pod Autoscaler)를 사용하여 지표(CPU 및 메모리 사용률, 요청 빈도, 지연 시간 및 과거 사용 데이터)를 기반으로 리소스를 확장하고 개별 포드에 대한 포드 수와 리소스 할당을 조정한다.

3-2. 포그 및 에지 배포

포그/에지 통합 AI 기반 서비스 제공이 다양하게 제안되었는데 인프라에 포그 서비스를 구축하여 원격 의료를 용이하게 하는 포그 서비스 계층을 제안이 대표적이다. 이를 위해 6G 통신 네트워크, 에지 장치(Wi-Fi 액세스 포인트, 라우터), 의료 IoT 장치와 같은 신기술의 융합을 활용하여 의료 서비스 제공 시스템을 위한 퍼지 기반 의사 결정 서비스 처리가 제안되었다.

의료 시스템을 위한 AI 기반 포그 컴퓨팅 솔루션에서 포그 장치는 포그 노드, AI 처리 장치, 그리고 건강 데이터베이스로 구성된다. 이 장치는 환자와 가까운 곳에서 환자 데이터를 수집하고, 다양한 AI 기술을 적용하여 환자 건강 상태를 감염 또는 건강 상태로 분류한다. 포그 데이터베이스는 클라우드 기반 중앙 데이터베이스와 동기화되므로 전체 시스템은 환자와의 근접성을 통해 확장된다. 지역 의료 서비스 제공자와의 실시간 통신을 통해 긴급한 의료 서비스가 필요한 환자를 동등하게 대우한다. 기존 클라우드 기반 의료 솔루션의 기능을 확장하기 위해 클라우드-포그 상호 운용성에 기반한 애플리케이션 개념을 제안되었다. 이 설정에서 포그-클라우드 지원 시뮬레이션 환경을 사용하여 검증된 일련의 실험 시나리오를 개발했다. 얻은 결과는 포그 기반 솔루션이 서비스 배포 품질, 비용, 에너지 사용량 및 네트워크 지연 측면에서 개선되었음을 보여준다. 이러한 패러다임의 힘을 활용하기 위해 분산 DL 기반 AI 모델을 이러한 환경에 통합하여 심장 환자 모니터링 시스템을 개발했다. 포그-클라우드 환경 설정으로 인해 제안된 솔루션은 환자의 심장 동작에서 불규칙성을 감지하는 데 높은 정확도를 유지하면서 저지연 응답을 제공할 수 있다.

에지 인텔리전스 측면에서 활발하게 연구되고 있는 두 가지 개념이 있는데 에지용 AI와 에지 상의 AI이다. AI for Edge에서는 복잡한 연산 부하가 포그 및 클라우드 네트워크와 같이 뛰어난 연산 능력을 갖춘 리소스로 분산된다. 이와 대조적으로 AI on Edge는 모든 머신러닝(ML) 작업을 엣지 디바이스에서 수행하는 것을 목표로 한다. 그러나 대부분의 기존 솔루션은 여전히 ??연합 학습(Federated Learning)이나 지식 증류(Knowledge Distillation)와 같은 기술에 중점을 두고 있다. 지식 증류에서는 일반 데이터 세트를 사용하여 기본 AI 모델을 개발하고, 학습된 특징을 엣지 디바이스로 전송하여 특정 데이터 세트를 기반으로 학습한다. 이러한 시나리오에서 기본 AI 모델은 클라우드/포그 네트워크에서 학습하고, 특정 모델은 엣지 디바이스에서 학습할 수 있다.

포그 컴퓨팅과 엣지 컴퓨팅 패러다임은 모두 컴퓨팅 서비스를 IoT 기기가 작동하는 네트워크 엣지에 더 가깝게 만든다. 그러나 애플리케이션과 IoT 기기는 추론 요구 사항이 다양하며, 모든 추론 작업을 엣지 또는 포그에서 수행할 필요는 없다. 이러한 다양성은 리소스 제약, 애플리케이션 요구 사항, 추론 작업의 복잡성과 같은 요인에서 비롯된다. 로컬 처리 기능을 활용할 수 있는 애플리케이션은 거의 없지만, 복잡한 계산을 위해 클라우드 리소스가 필요한 애플리케이션도 있다. 엣지 처리를 더 가깝게 수행하는 주요 이유는 작업 복잡성, 지연 시간, 에너지 소비, 네트워크 상태, 기기 리소스, 개인정보 보호 문제 등이다. 이러한 상황에서 데이터 기반 오프로드 기술을 사용하면 로컬, 엣지, 포그 또는 클라우드 리소스에서 AI 관련 작업을 수행하기 위해 서비스를 효과적으로 오프로드할 수 있다. 오프로드 알고리즘은 최적의 오프로드 결정을 내리기 위해 앞서 언급한 요인들을 고려해야 한다. 에지 및 포그에서 이러한 AI 관련 작업을 효율적으로 처리하기 위해 AIaaS 플랫폼을 활용하여 모델 학습, 서비스 제공 및 모니터링(SLA/SLO 매개변수), 사전 학습된 모델 액세스, 데이터 저장 및 관리, 다양한 처리 계층(에지, 포그)에 대한 모델 최적화, 클라이언트를 위한 데이터 시각화 및 분석 서비스 등의 서비스를 제공할 수 있다.

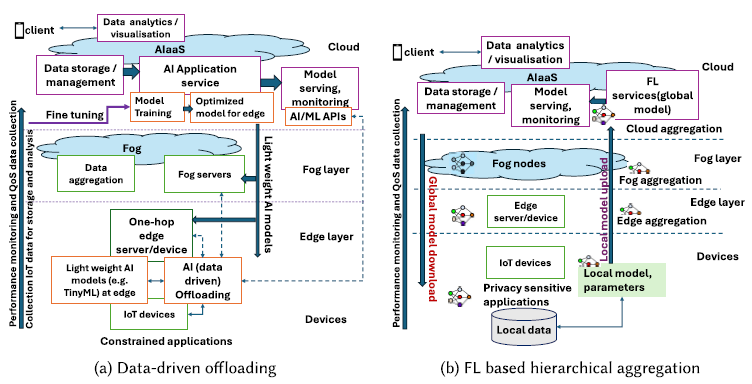

그림 8은 AIaaS 서비스를 데이터 기반 AI 추론 서비스에 사용할 수 있는 시나리오와 FL 기반 계층적 집계를 사용하여 데이터 프라이버시를 유지해야 하는 프라이버시 보호 사례를 보여준다.

[그림 8. FL 계층적 집계가 필요한 데이터 기반 오프로딩 시나리오 또는 개인 정보 보호 환경에서 엣지/포그 컴퓨팅을 위한 AIaaS 서비스]

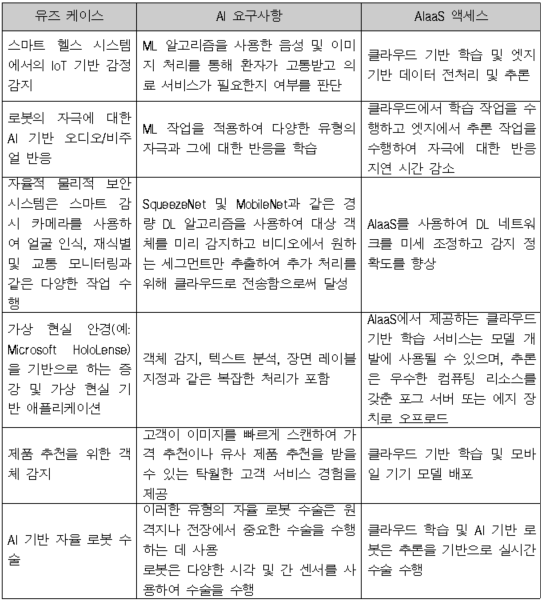

그림 8(a)에 제시된 데이터 기반 오프로딩 시나리오에서, 훈련된 오프로딩 알고리즘은 에너지, 지연 시간, 복잡성 및 기타 요소를 기반으로 작업을 로컬 디바이스 또는 상위 계층으로 오프로드할지 여부를 결정한다. AI 기반 오프로딩 기술의 몇 가지 예로는 클라우드에서 학습하고 에지에 최적화하여 에지에 배포하여 더 간단한 추론 작업을 수행할 수 있는 경량 AI 모델이 있다. 예를 들어, 제한된 기기에서 실행될 수 있는 TinyML 모델은 먼저 클라우드 AIaaS 배포에서 학습한 다음, 추론 서비스를 제공하기 위해 에지에 최적화 및 배포할 수 있다. 클라우드 서비스는 기존 모델을 구축하고 미세 조정하기 위해 에지에서 수집된 데이터를 위한 데이터 저장소도 제공할 수 있다. 학습된 모델은 에지에 더 가깝게 최적화 및 배포하거나, 더 복잡한 시나리오의 경우 AI/ML API를 사용하여 클라우드에서 직접 제공할 수 있다. 개인정보 보호 문제를 해결하기 위해 연합 학습 기반 접근 방식(그림 8(b))을 활용하고 계층적 배포를 사용하여 에지에서 수집된 데이터의 개인정보를 보호할 수 있다. 또한, 에지 및 포그 서버에서 모델 매개변수의 계층적 집계를 사용하여 모델을 개선할 수 있다. 표 4는 AIaaS와 에지 인텔리전스 통합의 몇 가지 중요한 유즈 케이스를 보여준다.

[표 4. 고급 에지 인텔리전스와 AIaaS 통합을 보여주는 유즈 케이스]

4.도전 과제와 기회

4-1. 개인정보 보호(Privacy)

AI는 방대한 양의 데이터를 필요로 하며, 다양한 출처를 통해 데이터를 수집하는 것은 어려운 일이지만, AIaaS 시스템은 사용자에게 개인정보 보호에 대한 확신을 제공해야 한다는 추가적인 부담을 안고 있다.

제공 가능한 개인정보 보호 수준은 데이터 민감도 범주 분석을 기반으로 정의할 수 있다. Amazon Web Services(AWS)의 전직 직원이 민감한 고객 데이터를 추출하기 위해 서버를 해킹한 혐의로 체포된 사례가 있는데, 아직 해결되지 않은 질문은 데이터가 AWS 서버에서 도난당했는지, 아니면 데이터 서버 보안 조치를 취하지 않은 AWS 클라이언트 측의 잘못인지 여부이다. AIaaS 운영에 채택된 데이터 보안에 대한 전체적인 접근 방식은 서비스 제공업체에게 필수적이면서도 어려운 과제이다. 개인정보 보호는 출처에서의 데이터 개인정보 보호, AIaaS 중앙 서버로 전송되는 데이터 개인정보 보호, 그리고 중앙 서버에서의 데이터 개인정보 보호로 분류할 수 있다. 모든 데이터의 개인정보 보호 처리에는 각 단계에서 데이터에 가해지는 위협을 식별하는 것이 포함될 수 있다. 개인정보 보호에 대한 일반적인 위협에는 데이터 유출, 데이터 변조, 소스, 전송 중 또는 AIaaS 서버에서의 데이터 손실이 포함된다.

또한, 악성코드 감염이나 피싱 공격을 통해 클라이언트 장치가 손상될 경우(클라이언트가 감염된 웹사이트 링크를 무의식적으로 클릭하는 경우) 데이터 개인정보 보호가 침해될 수 있다. 경계, 네트워크 및 애플리케이션 계층 보안 정책, 저장 데이터 및 전송 중인 데이터의 암호화, 무결성 검사 메커니즘 구축, 사용자 입력 및 웹 브라우저 활동 검증을 통해 AIaaS 모델에 개인정보 보호 조치를 도입할 수 있지만, 이러한 문제는 여전히 해결되지 않은 과제로 남아 있다.

4-2. 지연 시간(Latency)

클라우드에서 데이터를 실시간으로 처리하려면 신속한 데이터 전송이 AIaaS 플랫폼의 모든 참여 구성 요소, 즉 클라우드, IoT를 포함한 데이터 생성 장치, 클라이언트 머신, 그리고 기반 통신 네트워크의 공동 노력이 필요하다. 일반적으로 인터넷에 의존하면 통신 네트워크 혼잡이 발생하여 AIaaS 서비스 제공업체의 AI 기반 서비스 렌더링이 지연될 수 있다. 결과적으로 의사 결정 기능이 영향을 받아 최종 사용자 서비스에 영향을 미칠 수 있다. 예를 들어, 감시 카메라는 매시간 수 기가바이트의 데이터를 생성할 수 있다. 많은 카메라가 대용량 데이터(비디오/오디오 및 메타데이터 포함)를 생성하여 AIaaS 클라우드(즉, 클라우드 내 AI 엔진)에 렌더링하는 경우, 데이터 전송 지연 시간이 상당히 길어질 수 있다. 방화벽, 단일 및 다중 요소 인증 장치, 기타 네트워킹 장비(예: 스위치, 라우터)를 포함한 중간 보안 제어가 구축되면 지연 시간 문제가 더욱 악화된다. 이러한 과제를 해결하는 한 가지 방법은 데이터를 압축하여 전반적인 정확도를 낮추는 것이다. 하지만 이 방법은 중앙 집중식 AI 시스템에 데이터를 공급하기 위해 완전한 데이터 뷰가 필수적인 상황에는 적합하지 않다. 따라서 AIaaS 시스템에 남아 있는 과제는 클라이언트 기기와 중앙 AIaaS 시스템 간의 데이터 경로를 따라 많은 중간 홉이 존재하며, 이러한 각 중간 기기에서 발생하는 안정성 부족이다.

4-3. 리소스 할당 및 최적화

클라우드 또는 하위 계층을 위한 일반 AI 서비스 플랫폼의 리소스 할당 문제는 까다로운 문제이다. SLO 및 SLA를 유지하면서 AI 작업에 필요한 리소스 할당 및 프로비저닝에 필요한 개별 매개변수를 최적화하는 솔루션이 다양하게 제안되었는데 인스턴스 실행 비용, 추론 지연 시간, 정확도, 계산 비용/지연 시간, 하드웨어 할당 비용, 전송 지연 시간, 에너지 소비, 탄소 배출량 감소 등이 포함된다. 그러나 AIaaS 모델에서는 이러한 과제가 복합적으로 발생하며 서비스 제공업체는 최적의 서비스를 제공해야 한다. 불확실성이 큰 모델 기반 솔루션을 개발하는 것은 복잡한 작업이다. 따라서 이러한 상황에는 데이터 기반 솔루션이 적합할 수 있다. 그러나 이를 위해서는 클라우드 및 하위 계층(예: 포그 및 엣지)의 다양한 계층에서 다양한 매개변수를 모니터링해야 한다. 또한, 수집된 데이터의 보안 및 개인정보 보호는 효율적인 암호화 알고리즘을 사용하여 보장되어야 하며, 대용량 데이터 세트에 대한 ML/DL/RL 알고리즘을 학습하기 위해 데이터를 전송하고 중앙 위치에 저장하는 동안 보장되어야 한다. 하위 계층의 제약을 고려할 때, 이러한 모니터링 데이터를 전송하는 것 또한 중요한 과제이다. 또한, 또 다른 주요 과제는 리소스 할당 모델을 사이버 공격으로부터 보호하는 것이다. 사이버 공격은 리소스의 효과적인 할당을 위협하여 서비스 거부 공격으로 이어질 수 있다.

4-4. 데이터 사일로

데이터 사일로는 AIaaS 패러다임의 여러 부분에서 정보 공유 및 협업을 방해한다. 데이터 사일로는 일반적으로 출력 결과의 정확도에 영향을 미치기 때문에 AI 결과의 품질에도 영향을 미칠 수 있다. 네트워크 운영 및 보안 제어/운영 애플리케이션을 추가하면 이 숫자는 더욱 증가한다. 여러 애플리케이션을 사용하는 조직에서 데이터 사일로 문제는 다양한 사일로에서 데이터를 통합하여 AIaaS 서버에 제공할 수 있도록 정리되고 구조화되며 정확한 데이터 세트를 생성할 때 문제가 된다. 소스(클라이언트 기기)에서 데이터를 처리하거나 중앙 집중식 AIaaS 시스템의 AI 엔진에 제공하기 전에 데이터를 처리하는 문제는 활발한 연구 주제이다.

4-5. 정확성

AIaaS 패러다임의 분산화로 인해 효율성과 신뢰성이 크게 향상되었지만, 정확도 측면은 여전히 ??개선이 필요하다. AI 애플리케이션은 처리되거나 큐레이션된 데이터에 의존하여 AI 엔진이 이를 해석하고 정확한 출력을 생성한다.

그러나 데이터가 이기종 데이터 소스(IoT 클라이언트 기기 포함)에서 생성되고, 데이터 생성 및 현장 저장을 위한 적절한 인프라가 부족하거나 중앙 집중식 클라우드로 전송되지 않아 데이터에 부정확성이 있는 경우, AI 엔진에서 생성되는 출력의 품질이 저하될 수 있다. 또한 통신 지연 문제를 해결하기 위해 대부분의 AI 작업은 엣지 또는 포그 컴퓨팅 시설에서 수행되고 중요한 의사 결정 변수만 클라우드에 업데이트된다. 따라서 전체 데이터가 없으면 클라우드 AI의 정확도가 저하된다.

데이터 사일로 또한 정확도 문제의 원인이 된다. 정확도 문제를 해결하기 위해 연구자들은 새로운 기술과 솔루션을 개발하고 있다. 연합 학습은 클라우드 데이터 센터에서 모델을 집계하여 데이터가 최종 기기를 벗어나지 않고도 유사한 분류 또는 예측 정확도를 생성할 수 있으며, 개인정보 보호를 보장한다. 또한, 컴퓨팅 리소스는 효율성과 정확도를 모두 향상시키는 최신 기술을 통해 세 계층(에지, 포그, 클라우드) 모두에서 매일 업그레이드되고 있다.

5. 결언

본 고에서는 클라우드, 에지, 포그 컴퓨팅 프레임워크에서 AI가 어떻게 도입되고 있는지에 대한 포괄적인 고찰을 제시했다. 이 고찰을 통해 AI 애플리케이션은 네트워킹부터 중요 인프라 애플리케이션에 이르기까지 다양한 응용 분야에서 상당한 잠재력을 가지고 있음을 확인했다. AIaaS를 제공하기 위해 충족해야 하는 다양한 특성과 기능을 설명하였다. "aaS"의 필수 특성과 AI 기반 서비스의 기능을 지원하는 AIaaS를 제공하는 벤치마크 프레임워크와 최종 사용자를 위한 AI 서비스 도입을 입증하는 다양한 사례를 포함하여 기술하였다. "SaaS", "IaaS", "PaaS"와 같은 성공적인 "aaS" 프레임워크와 마찬가지로, "AIaaS"는 고급 자동화, 모니터링, 제어 및 의사 결정에 상당한 영향을 미치고 있는데 AIaaS의 기능을 보여주기 위해 몇 가지 실제 사용 사례를 포함하여 설명하였다.

21세기 정보 인프라의 핵심 축은 클라우드, 에지, 포그 컴퓨팅이 상호보완적으로 결합해 데이터 생성부터 의사결정에 이르는 전 과정을 아우르는 생태계를 형성하는 데 있다. 이 프레임워크에 AI를 통합하는 노력은 단순한 자동화 수준을 넘어서, 지능화된 데이터 처리·예측·최적화를 통해 네트워크와 인프라 운영 전반을 혁신하고 있다.

클라우드 컴퓨팅은 방대한 데이터 저장·처리 역량을 기반으로 AI 모델의 학습과 대규모 분석을 수행하는 주력 플랫폼으로 자리 잡았다. 복잡한 딥러닝 모델, 생성형 AI, 예측 분석 등의 고부가가치 서비스를 클라우드에 구축함으로써 기업과 공공기관은 높은 연산 자원을 탄력적으로 활용할 수 있게 되었다. 예를 들어, 헬스케어에서는 클라우드 기반 영상 인식 AI가 방대한 의료 데이터를 분석하여 진단 지원을 고도화하고, 금융권에서는 실시간 사기 탐지와 리스크 예측이 서비스형 인공지능(AIaaS) 형태로 제공되고 있다.

에지 컴퓨팅은 데이터를 발생 지점에서 실시간으로 처리하는 것을 목표로, 클라우드와 달리 낮은 지연(latency)과 높은 응답성을 요구하는 환경에서 AI의 가치를 극대화한다. 자율주행차, 산업 로봇, 스마트 시티 IoT 센서 등에서 AI 추론(inference)을 단말 장치나 게이트웨이 수준에서 수행해 즉각적인 의사결정을 가능하게 한다. 특히 비디오 스트리밍, 교통제어, 에너지 관리 같은 미션 크리티컬 애플리케이션에서는 에지 AI가 지연을 획기적으로 줄이고, 대역폭 사용을 최적화하며, 보안을 강화하는 성과를 보이고 있다.

포그 컴퓨팅은 클라우드와 에지의 중간계층으로, 지리적으로 분산된 노드에서 데이터 사전처리·집계·분석을 담당하며 AI의 분산 실행을 지원한다. 포그 노드는 인프라 전반에 계층적 AI 연산 계층을 형성해, 네트워크 혼잡을 완화하고 클라우드의 부하를 분산시키며, 에지 장치의 연산 부담도 경감한다. 산업제조 현장에서는 포그 컴퓨팅을 활용해 생산설비 상태 예측, 품질 이상 탐지, 자원 배분 최적화 등의 AI 기반 의사결정을 수행해 공정 효율성을 높이고 있다.

세 가지 컴퓨팅 패러다임은 상호 독립적이지 않으며, 각각의 특성과 이점을 결합하는 하이브리드 아키텍처가 AI 활용의 핵심 전략으로 부상하고 있다. 예를 들어, 대규모 모델 학습은 클라우드에서 수행하고, 추론과 응답은 포그와 에지에서 분산 처리하는 방식으로 통합 프레임워크를 설계하는 사례가 증가하고 있다. 이를 통해 비용·지연·확장성·보안의 균형을 맞추면서 AI 서비스의 품질을 극대화할 수 있다.

또한, AI의 도입은 네트워킹과 인프라 자체의 지능화를 촉진하고 있다. 소프트웨어 정의 네트워크(SDN), 네트워크 기능 가상화(NFV), 5G 네트워크 슬라이싱 등 네트워크 제어·운영 기술에 AI를 접목해 네트워크 자원 할당과 트래픽 예측, 장애 대응 등을 자동화하는 것이 현실화되고 있다. 통신사업자와 클라우드 제공업체는 AI 기반 네트워크 최적화를 통해 서비스 안정성을 높이고, 새로운 비즈니스 모델을 창출하고 있다.

이처럼 AI는 특정 도메인에 한정되지 않고, 네트워킹부터 산업, 헬스케어, 금융, 스마트 시티에 이르는 다양한 응용 분야에서 막대한 잠재력을 지니고 있다. 클라우드·에지·포그를 아우르는 컴퓨팅 프레임워크는 이러한 잠재력을 실제 가치로 전환하는 핵심 플랫폼으로 자리매김하고 있다. 특히 데이터 주도형 혁신이 가속화됨에 따라, AI는 단순한 보조적 기술이 아니라 디지털 전환의 중심적 동력으로 진화하고 있다.

결론적으로, 클라우드·에지·포그의 통합된 AI 인프라는 미래의 지능형 사회를 실현하는 필수적인 기반이 될 것이다. 앞으로 데이터 규모와 다양성이 더욱 커지고, AI 알고리즘과 하드웨어가 발전함에 따라, 지연이 거의 없는 실시간 예측·제어·의사결정이 일상화될 것으로 예상된다. 이를 위해서는 신뢰성·보안·데이터 주권 문제에 대한 지속적인 연구와 표준화가 병행되어야 하며, 다양한 산업의 이해관계자가 협력해 하이브리드 AI 아키텍처를 설계·구축하는 전략적 접근이 필수적이다. 이러한 맥락에서 AI 애플리케이션은 기존의 정보 시스템을 넘어 사회적·경제적 가치를 창출하는 주축이 될 것이며, 클라우드·에지·포그 컴퓨팅의 융합은 AI 잠재력 실현의 가장 중요한 촉매로 자리할 것이다.

참 고 문 헌

- JongGwan An,Wenbin Li, Franck Le Gall, Ernoe Kovac, Jaeho Kim, Tarik Taleb, and JaeSeung Song. 2019. EiF: Toward an elastic IoT Fog framework for AI services. IEEE Communications Magazine 57, 5 (2019), 28?33.

- Wenchao Xia, Xinruo Zhang, Gan Zheng, Jun Zhang, Shi Jin, and Hongbo Zhu. 2020. The interplay between artificial intelligence and fog radio access networks. China Communications 17, 8 (2020), 1?13.

- Shi, W., Cao, J., Zhang, Q., Li, Y., & Xu, L. (2016). Edge Computing: Vision and Challenges. IEEE Internet of Things Journal, 3(5), 637?646.

- Cisco Systems. (2015). Fog Computing and the Internet of Things: Extend the Cloud to Where the Things Are. Cisco White Paper.

- Satyanarayanan, M. (2017). The Emergence of Edge Computing. Computer, 50(1), 30?39.

- Zhang, C., Patras, P., & Haddadi, H. (2019). Deep Learning in Mobile and Wireless Networking: A Survey. IEEE Communications Surveys & Tutorials, 21(3), 2224?2287.

- Varghese, B., & Buyya, R. (2018). Next Generation Cloud Computing: New Trends and Research Directions. Future Generation Computer Systems, 79, 849?861.

- OpenFog Consortium Architecture Working Group. (2017). OpenFog Reference Architecture for Fog Computing. https://www.openfogconsortium.org/ra/

- TU-T Y.4208 (2020). Requirements and capabilities for AI-based edge computing.International Telecommunication Union (ITU-T).

https://www.itu.int/rec/T-REC-Y.4208-202006-I - Bahga, A., & Madisetti, V. (2016). Internet of Things: A Hands-on Approach. Universities Press.

- Amazon Web Services. (2023). Machine Learning at the Edge: Overview. AWS Documentation.

https://docs.aws.amazon.com/whitepapers/latest/machine-learning-edge/machine-learning-edge.pdf - Google Cloud. (2022). Edge AI Solutions. Google Cloud White Paper.

https://cloud.google.com/solutions/edge-ai

저작권 정책

SaaS 전환지원센터의 저작물인 『클라우드, 포그, 엣지를 위한 서비스형 인공지능(AIaaS)』은 SaaS 전환지원센터에서 상명대학교 서광규 교수에게 집필 자문을 받아 발행한 전문정보 브리프로, SaaS 전환지원센터의 저작권정책에 따라 이용할 수 있습니다.

다만 사진, 이미지, 인용자료 등 제3자에게 저작권이 있는 경우 원저작권자가 정한 바에 따릅니다.