마이크로소프트? / 김대우 이사

예측 9: 2027년까지, GenAI 추론의 확장 문제에 직면한 80%의 CIO는

성능 및 데이터 컴플라이언스 요건을 충족하기 위해

클라우드 제공업체의 엣지 서비스를 활용할 것

- IDC FutureScape: Worldwide Cloud 2025 Predictions

2023년 이후 생성형 AI(이하 GenAI) 기술은 다양한 산업에서 혁신과 변화를 이끌고 있습니다.

데이터와 성능, 그리고 컴플라이언스의 삼중고

AI의 진정한 가치는 실제 데이터가 발생하는 제공(Serving) 단계부터 시작됩니다. 특히 GenAI 모델은 학습 단계 이후 실제 서비스로 운영되는 환경, 즉 서빙 단계에서, 지속적으로 사용자의 데이터를 받으며 판단을 내리는 ‘추론(Inferencing)’ 단계에서, 비로소 비즈니스의 혁신을 이끌어냅니다.

이미지: 현장 실시간 AI 추론의 혁신, 엣지(Edge) AI란?

이렇게 AI 기술은 지속적으로 발전하는 중이지만 현실은 다릅니다. IDC 조사에 따르면, 실제 기업이 셀프로 프로덕션 하는 GenAI 프로젝트는 극소수에 불과한 것으로 조사되었습니다. 그 이유는 간단합니다. GPU 클러스터 같은 고성능 컴퓨팅 인프라를 실제 데이터가 흘러 다니는 수많은 AI 서비스마다 직접 설치, 관리하는데 소요되는 막대한 비용과, 변화하는 데이터 컴플라이언스 규정 준수까지 고려해야 하기 때문입니다.

AI 모델 서비스 비용

AI를 “직접 운영에 적용”하면서 문제가 발생합니다. 예를 들어, 가볍고 작은 언어 모델(SLMs)로 인기 있는 Llama 3.1 8B를 이용해 실제 추론 서비스를 테스트해 보면, 고성능 GPU 머신이나 전용칩을 이용하지 않는 이상 속도가 사용이 불가할 정도로 응답이 느리고, 동시다수 사용자가 접근하는 프로덕션 환경에 적용하려면 예상보다 훨씬 강력한 고성능 GPU 컴퓨팅 클러스터가 필요한 것을 인지하게 됩니다.

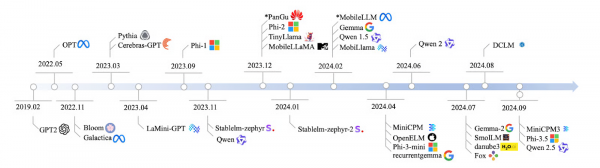

출처: Small Language Models: A Guide With Examples

상세 운영비 - LLM 셀프 호스트 사례

The cost of self-hosted LLM model in AWS 문서는, 실제 Llama를 도입한 경험을 공유하고 있습니다.

이 글은 AWS에서 LLama v3.2 모델을 실행할 때 비용을 계산합니다. LLama v3.2 모델을 대상으로, 업무 시간(주 40시간) 운영과 24/7 상시 운영이라는 두 가지 시나리오에서의 비용을 산정하고 있으며, 다른 저장소나 API 서비스, 데이터베이스와 피드백 루프를 위한 구조는 전혀 포함되어 있지 않은, 오직 단일 라마만 호스팅 하기 위한 깡통입니다.

- 업무 시간만 사용할 경우(월 160시간), 소형 모델(1B)은 월 약 9만 원, 대형 모델(90B)은 280만 원

- 24/7 가동(월 720시간) 시 소형 모델은 약 38만 원, 대형 모델은 약 1200만 원

- 중간 규모인 3B, 11B Vision 모델도 각각 수십~수백만 원대의 차이 발생

인스턴스 선정은 라마 모델마다 필요한 GPU와 메모리 용량을 기준으로 되었으며, EC2 VM 인스턴스 비용만 반영되었습니다. 별도의 저장소 비용조차 없고, 다른 할인 플랜은 포함되지 않았습니다.

이 자료를 통해, 순수한 AI 모델의 성능과 실제 운영 방식(업무시간/전체시간)에 따라 매월 필요한 IT 인프라 예산의 규모를 대략적으로 살펴볼 수 있습니다.

이미지: Llama - NVIDIA

GenAI 추론, 여러 난제들

라마 사용량 계산을 보니 생각보다 저렴한데? 라고 생각하실 수 있지만, 여전히 도입은 쉽지 않습니다.

GenAI는 다양한 산업에 새로운 가능성을 제시했지만, 여전히, 실제 서비스 단계인 추론(Inference) 과정에서는 많은 문제가 있습니다.

강력한 컴퓨팅 성능 필요

대형 언어 모델(LLM)은 개발, 모델 트레이닝뿐만 아니라 서비스 추론 단계에서도 강력한 컴퓨팅 파워를 필요로 합니다. Llama 3.1 8B처럼 상대적으로 작은 모델조차 실시간 응답을 위해서는 고성능 GPU를 요구하는 현실은, 기업의 IT 인프라에 큰 부담을 안기고 있습니다.

참고링크: Meta Llama AI Requirements

응답 시간 지연(Latency) 문제

대부분의 GenAI 서비스는 클라우드 중심 구조를 채택하고 있습니다. 이 경우, 추론 요청이 요청을 처리하는 서버까지 전달되고, 다시 결과가 전송되어야 하므로, 물리적 거리와 네트워크 환경에 따라 상당한 지연이 발생할 수 있습니다. 특히 자율주행이나 제조업 등 저지연, 실시간 처리가 필수적인 산업에서는 이러한 응답 시간 지연이 치명적인 제한 요소가 됩니다.

확장성 제한 문제

어렵게 서비스 중인 우리의 GenAI 기반 서비스를 이용하는 사용자가 늘어날수록 추론 시스템은 병목 현상에 직면하게 됩니다. 동시에 여러 사용자의 요청이 몰릴 경우, 시스템은 느려지고 처리 용량 한계로 인해 전체 서비스 품질 저하가 발생할 수 있습니다.

비용 효율성

전통적인 방식인, 항상 최대치 용량을 산정해 고비용 GPU 클러스터를 구매하고 운영하는 것은 상당한 비용이 필요합니다. 사용량이 일정치 않은 초기 비즈니스 상황 같은 경우, GPU 리소스를 제대로 활용되지 못해 ROI가 떨어지는 문제도 발생합니다.

이처럼 GenAI 추론을 직접 서비스할 경우 성능, 응답 속도, 확장, 비용 관리라는 네 개의 난제를 해결해야 합니다.

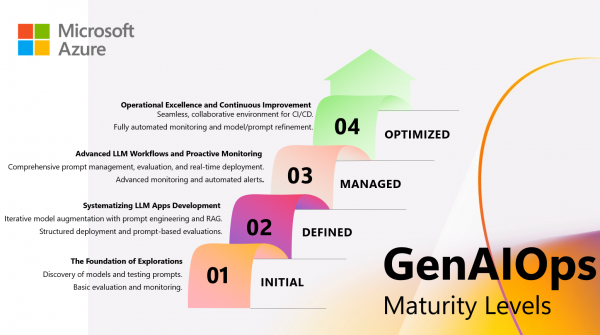

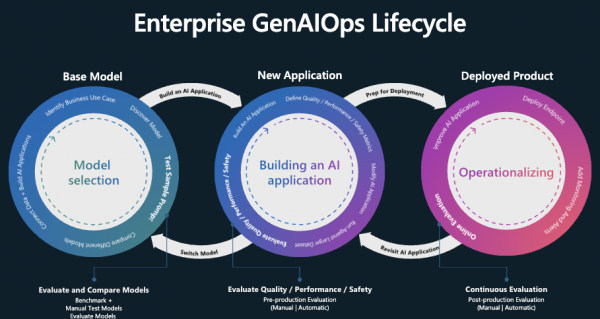

AI 모델 서비스 보이지 않는 비용

단순 AI 추론 비용뿐만 아니라, 운영 측면에서도 GenAIOps 환경 구성, 고가용성 확보, 자동화 및 모니터링 등 관리 복잡성이 증가합니다. 전문가 인력과 리소스가 부족하다면 서비스 안정성에 직접 위험으로 이어질 수 있습니다.

Advance your maturity level for Generative Artificial Intelligence Operations (GenAIOps) - Microsoft

실제 프로덕션 환경이나 국가/지역 규제로 인한 제한 상황이 아니라면, OpenAI, HuggingFace 등 CSP가 제공하는 클라우드 기반 API를 사용하는 것이 더 경제적이고 효율적입니다.

셀프호스팅은 철저한 비용 분석과 충분한 준비, 보안·규제 등 불가피한 사유가 있을 때에만 신중하게 접근하는 것이 바람직합니다.

AI 엣지 서비스

추론 서비스용 고성능 GPU 컴퓨팅 환경과 급증하는 데이터, 그리고 강화되는 거버넌스 및 데이터 컴플라이언스 상황은, 기업이 직접 호스팅 하는 AI 추론 서비스를 프로덕션 단계로 가져갈 때 상당한 걸림돌이 됩니다.

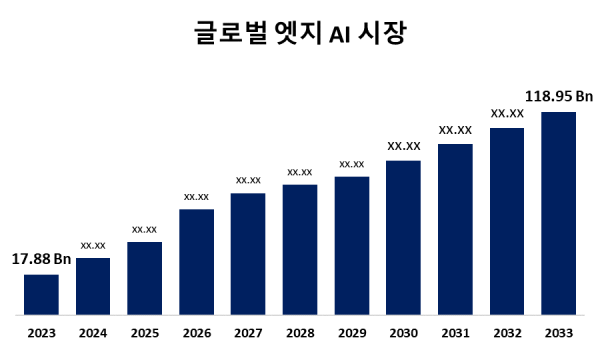

앞으로 2년, 2027년까지 많은 전문가들은 80%에 가까운 기업이 이러한 컴퓨팅 성능과 준법 요건을 만족시키기 위해 클라우드 기반 엣지 서비스를 활용할 것으로 전망합니다.

그렇다면 왜 클라우드 기반 엣지 서비스가 GenAI 성공의 핵심일까요?

세계 에지 AI 시장 규모, 점유율 - spherical insights

클라우드 엣지 서비스가 제공하는 “해법”

이러한 여러 복잡한 난제를 해결할 방안은 바로 클라우드 기반 엣지 서비스입니다. CSP가 제공하는 엣지 컴퓨팅 서비스를 활용해 전 세계 어디서든 고성능 GPU 컴퓨팅 자원을 원하는 만큼 유연하게 전개할 수 있습니다. 또한, 변화가 잦은 데이터 주권 및 컴플라이언스도 각 국가나 지역의 규제와 정책을 반영해 운영 가능합니다.

실제로 많은 국내외 기업들은 엣지 인프라를 직접 구축하기보다는 글로벌 CSP의 엣지 서비스를 활용해 신속하게 GenAI 추론 프로젝트를 전개하고 있습니다.

Build your own private ChatGPT style app with enterprise-ready architecture

글로벌 CSP와 엣지 AI 서비스

클라우드에서만 가능하던 고급 분석과 추론이 점차 네트워크의 말단, 즉 “엣지”로 확장되고 있습니다. 이에 대응해 글로벌 CSP도 다양한 엣지 AI 서비스를 제공하고 있습니다.

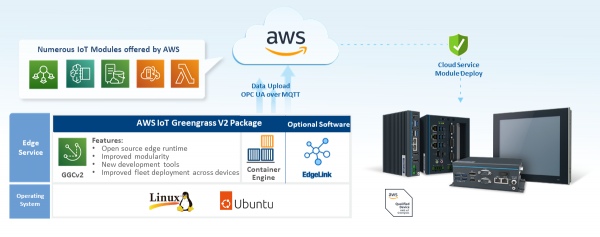

AWS - 일관된 하이브리드와 다변화된 엣지 서비스

AWS는 클라우드와 온프레미스를 연결하는 하이브리드 환경을 강조합니다. AWS IoT Greengrass로 엣지 디바이스에서 클라우드 연계를 제공해 인텔리전스 엣지 디바이스로 확장 가능합니다.

이미지: AWS IoT Greengrass - advantech

AWS IoT Greengrass

조금 더 큰 규모로, AWS Outposts는 기업의 데이터센터나 자체 시스템에 AWS의 인프라와 서비스 환경을 직접 확장해, 클라우드와 거의 차이가 없는 통합 운용을 가능하게 합니다. 지사나 공장 단위의 워크로드에서 적합한 AI 엣지 서비스로 운영 가능합니다.

Powering generative AI/ML solutions with AWS Outposts Servers at Edge locations - AWS

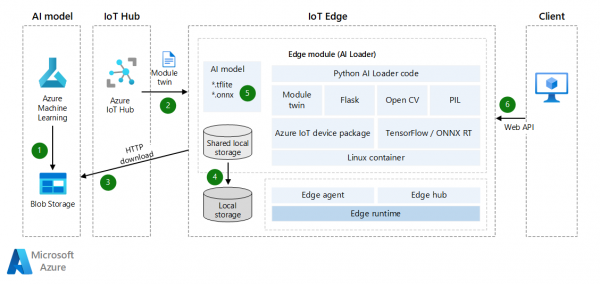

Microsoft Azure - 강화된 디바이스 관리와 AI 가속

Microsoft Azure 역시 다양한 엣지 컴퓨팅 솔루션을 보유하고 있습니다. Azure IoT Edge는 클라우드의 분석 기능이나 인공지능 추론 기능을 엣지로 옮겨, 데이터가 생성된 곳에서 즉시 처리 및 분석이 이뤄질 수 있게 합니다. 이로써 불필요한 데이터 이동 없이 빠르고 실시간에 가까운 응답을 확보할 수 있습니다.

Enable machine learning inference on an Azure IoT Edge device

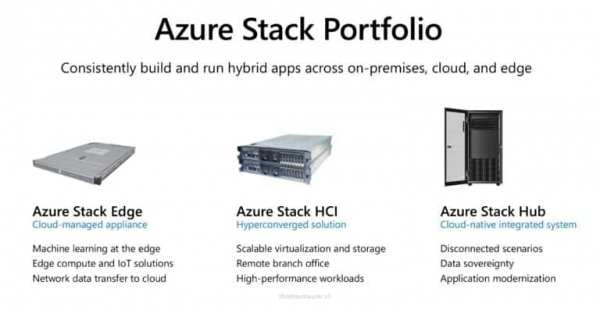

조금 더 큰 규모로, Azure Stack Edge는 관리형 컴퓨팅 장비를 통해, 현장에서 인공지능 추론과 데이터 저장, 관리를 한꺼번에 제공합니다. 이 장비에는 NVIDIA의 고성능 V100, T4 또는 AMD MI25 GPU가 탑재되어, AI 업무 처리 속도를 획기적으로 향상시킵니다.

Graphics processing unit (GPU) virtual machine (VM) on Azure Stack Hub - Microsoft Azure Stack hub

An Overview at the New Azure Stack Portfolio - Thomasmaurer

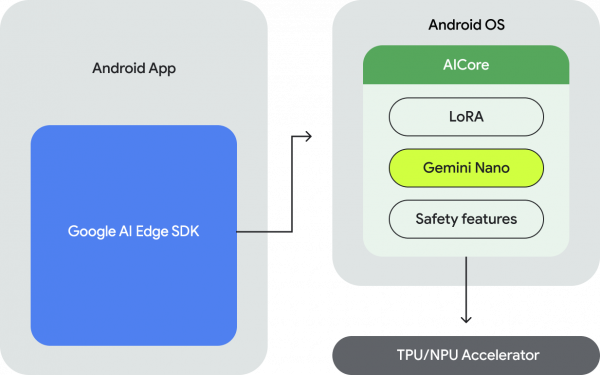

Google AI Edge, 경량 AI 추론에 최적화

Google은 엣지 컴퓨팅 영역에서도 폭넓은 확장성을 선보이고 있습니다. Google AI Edge로 다양한 Android부터 임베디드 기기까지 다양한 환경에 배포 가능하고 과거 TensorFlow Lite로 알려진, Lite RT 런타임으로 인퍼런스 프레임워크를 제공합니다.

AI Core 아키텍처 - https://developer.android.com/ai/gemini-nano/ai-edge-sdk

흥미로운 점은 이렇게 Gemini Nano를 AICore에 기본 탑재하는 전략이 엿보입니다.

아울러 Google TPU는 구글이 개발한 전용 칩셋으로, 현장 단말에서 AI 모델을 빠르고 효과적으로 실행할 수 있도록 최적화되어 있습니다.

참고링크: Cloud TPU 소개

구글은 다양한 하드웨어 파트너사와 협력해 각종 게이트웨이 및 장치도 제공, 맞춤형 엣지 컴퓨팅 환경의 구축까지 지원하며 시장에서의 입지를 다지고 있습니다.

이렇게 각 글로벌 CSP들은 저마다의 엣지 AI 전략을 추구하고 있으며, 다양한 산업 현장에 적용하고 있습니다.

데이터 보안과 컴플라이언스, 그리고 인력 부담 절감

GenAI의 성공은 잘 정제된 대량 데이터를 얼마나 안전하게, 적절하게 재학습에 활용하느냐에 달려있다고 해도 과언이 아닙니다. 데이터의 이동이나 저장 방식에 따라 국가나 지역마다 준수해야 할 법적 요구사항이 다르기 때문입니다.

산업 전반에 걸쳐 데이터 거버넌스 및 컴플라이언스와 관련한 내부 인력 부담도 점점 증가하고 있습니다. 따라서 이러한 데이터 전문성을 보유한 CSP와 협업하는 것이 GenAI 도입 위험을 최소화하는 하나의 전략이 될 수 있습니다.

하이브리드·멀티클라우드 시대, 유연한 데이터 통합이 해답

GenAI 프로젝트는 여러 국가나 지역, 다양한 CSP와 On-premise 환경에서 생성되는 수많은 데이터를 처리해야 합니다. 즉, 클라우드 플랫폼은 반드시 멀티클라우드나 하이브리드 컴퓨팅 환경과도 연동할 수 있어야 하고, 이 과정에서 데이터의 가치를 최대한 끌어내는 것이 중요해질 것입니다.

Observability in generative AI

다가올 변화와 준비

GenAI 추론 프로젝트는 향후 모든 비즈니스의 혁신과 핵심 경쟁력이 될 것입니다. 기업은 직접 GenAI 인프라에 투자하는 대신, 변화하는 규제와 비즈니스 환경에 빠르게 적응할 수 있는 CSP를 적극적으로 검토해야 합니다.

참 고 문 헌

- https://www.marketresearch.com/IDC-v2477/IDC-FutureScape-Worldwide-Cloud-Predictions-38665932/

- https://www.gartner.com/en/newsroom/press-releases/2025-05-13-gartner-identifies-top-trends-shaping-the-future-of-cloud

- https://www.datacamp.com/blog/small-language-models

- https://techcommunity.microsoft.com/blog/microsoftmechanicsblog/build-your-own-private-chatgpt-style-app-with-enterprise-ready-architecture/4069529

- https://blog-ko.superb-ai.com/real-time-ai-inference-edge-ai-innovation/

- https://learn.microsoft.com/en-us/azure/ai-foundry/concepts/observability

- https://dev.to/yyarmoshyk/the-cost-of-self-hosted-llm-model-in-aws-4ijk

- https://llamaimodel.com/requirements/

- https://learn.microsoft.com/en-us/azure/machine-learning/prompt-flow/concept-llmops-maturity?view=azureml-api-2

- https://www.sphericalinsights.kr/reports/edge-ai-market

- https://aws.amazon.com/greengrass/?nc1=h_ls

- https://aws.amazon.com/blogs/compute/powering-generative-ai-ml-solutions-with-aws-outposts-servers-at-edge-locations/

- https://learn.microsoft.com/en-us/azure/architecture/guide/iot/machine-learning-inference-iot-edge

- https://learn.microsoft.com/en-us/azure-stack/user/gpu-vms-about?view=azs-2408

- https://ai.google.dev/edge/litert?hl=ko

- https://developer.android.com/ai/gemini-nano/ai-edge-sdk

- https://cloud.google.com/tpu/docs/intro-to-tpu?hl=ko

저작권 정책

SaaS 전환지원센터의 저작물인 『2025 클라우드 트렌드 : GenAI와 클라우드 엣지 서비스』은 SaaS 전환지원센터에서 마이크로소프트 김대우 이사에게 집필 자문을 받아 발행한 전문정보 브리프로, SaaS 전환지원센터의 저작권정책에 따라 이용할 수 있습니다.

다만 사진, 이미지, 인용자료 등 제3자에게 저작권이 있는 경우 원저작권자가 정한 바에 따릅니다.